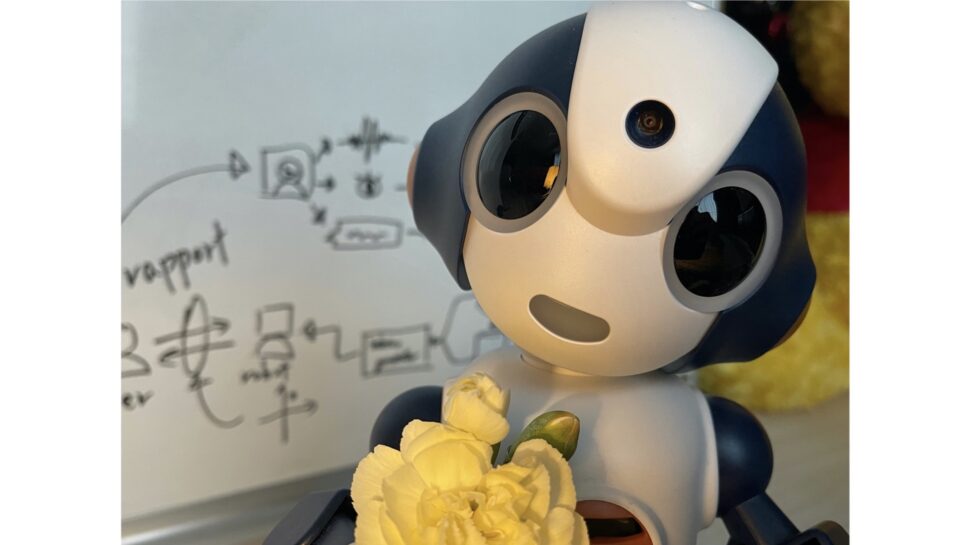

Can a Counseling Robot Be a Lifelong Partner?

Modern society places many burdens on us and puts us at constant risk of mental health problems. Studies have shown that approximately one in three people have mental health problems, and counseling can be part of the solution. Counseling with people has been the norm, but it has been pointed out that this form of counseling has the psychological barrier of making people overly conscious of their therapist’s evaluation of them. Therefore, counseling with robots is attracting attention.

However, it is known to be difficult to establish a continuous relationship with a robot. This is because robots cannot accurately estimate a person’s condition and generate appropriate words and actions for each person. In order to accurately estimate a person’s state, it is necessary for the robot to extract features such as the facial expressions of the person being interacted with. In order for this to continue, the robot must continue to encourage self-disclosure to the person. Therefore, we believe that designing the robot’s words and actions to facilitate self-disclosure by the person will contribute to building a long-term relationship between the person and the robot and enhance the effectiveness of counseling.

Therefore, prior to the workshop, we implemented a dialogue system that encourages self-disclosure, and conducted an experiment in which participants interacted with a robot embedded with the system for one week. The workshop was then held for the participants of the experiment. During the workshop, participants were asked to think about how to establish a long-term relationship with the robot. The participants were also asked to think about where the robot could be applied to generate empathetic speech and behavior based on their estimated quality of life.

企画の背景

現代社会は我々に多くの負担を強いており、常に精神的健康を害するリスクにさらされている。約3人に1人がメンタルヘルスの問題を抱えているという調査結果もあり、カウンセリングはその解決の一翼を担う。これまでは人を相手としたカウンセリングが主流であったが、この形式にはセラピストからの評価を過剰に意識してしまうという心理的障壁があることが指摘されてきた。支援を必要としながらも、80%以上の人々が専門機関を利用していないという報告もあり、サービスギャップの存在が問題視されている。そこで、ロボットを相手にしたカウンセリングが注目されている。

しかし、ロボットと永続的な関係を築くことは難しいことが知られている。これは、ロボットが人の状態を正確に推定し、一人ひとりに適した言動を生成することができないためである。人の状態を正確に推定するためには、ロボットが対話中の人の表情などから特徴を抽出する必要がある。これを継続させるためには、ロボットが人への自己開示を促し続けなければならない。そこで、人が自己開示をしやすいようにロボットの言動をデザインすることが、人とロボットとの長期的関係構築に寄与し、カウンセリングの効果を高めることにつながると考える。

したがって、ワークショップに先立ち、自己開示を促す対話システムを実装し、そのシステムを組み込んだロボットと1週間対話をしてもらう実験を実施した。その後、実験参加者を対象としたワークショップを開催した。ワークショップでは、参加者にロボットと長期的な関係を築くにはどうすればよいかを考えてもらった。また、推定されたQOLをもとに共感的な言動を生成するロボットの応用先について参加者に考えてもらった。

どんなワークショップ?

実験では、カウンセリングの手法の1つである認知行動療法に則った言動、及び、共感的言動を行う対話ロボットを実装し、1週間、ロボットと一緒に思考の整理をしてもらった。毎日ロボットと対話する前後それぞれでアンケートに回答してもらい、自己開示度合いや共感度合いなどを評価し、それがロボットに対する印象にどのような関連があるかを調べた。

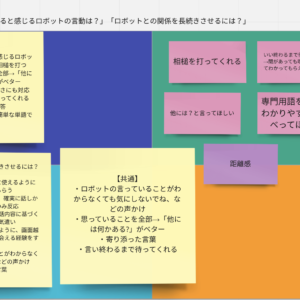

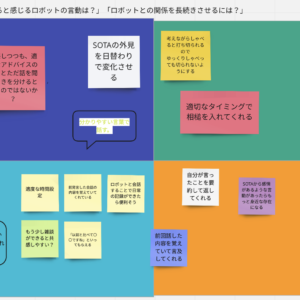

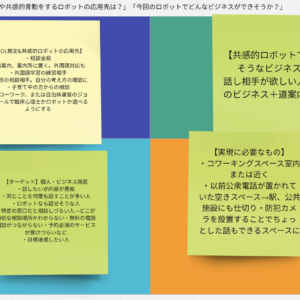

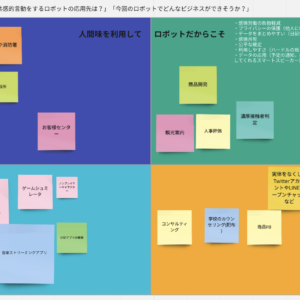

WSでは、参加者を2つのグループに分け、それぞれでアイスブレイクをかねた自己紹介を行ったのちに、2つのディスカッションを行った。1つ目は、「共感されていると感じるロボットの言動は?」「ロボットとの関係を長続きさせるには?」について、その要素を挙げてもらい、2つ目は、「QOL推定や共感的言動をするロボットの応用先は?」「今回のロボットでどんなビジネスができそうか?」というテーマで議論してもらった。オンラインホワイトボードMiroを用いたグループディスカッションを行ったのちに、全体発表の時間を設け、グループ間の意見交換を行った。

プログラム

| 10min | ワークショップ趣旨確認,目的説明,調査内容の振り返り,Miroの説明 | |

|---|---|---|

| 5min | アイスブレイク | |

| 30min | グループワーク1 | |

| 20min | 1グループあたり3分間の発表,質問,相互ディスカッション | |

| 35min | グループワーク2 | |

| 20min | 1グループあたり3分間の発表,質問,相互ディスカッション | |

| 15min | WSのまとめ,振り返り | |

| 10min | アンケートへの回答(WSに参加した感想) |

ワークショップの成果

ふり返り

| アイテム | 対話ロボットSOTA |

|

|---|---|---|

| 開催日時 | 2022年2月14日〜21日,26日 |

|

| 場所 | Zoomを用いたオンラインワークショップ |

|

| 参加者・人数 | 合計7名 / ロボットカウンセリング実験の参加者7名 |

|

| 講師/ファシリテーター | ファシリテーター : |

原稿執筆:中川聡